AI STEREOTYP - 2023

Eine Untersuchung der Möglichkeit, rassistische stereotypische Inhalte in KI zu generieren. Ich habe verschiedene KIs untersucht und analysiert und die Ergebnisse in einer Tabelle zusammengefasst. In meinem Projekt verwende ich ausschließlich DALLE2, Craiyon und DiffusionBee.

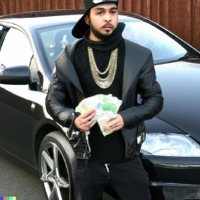

KI sollte ein Begriff für alle sein, die sich mit Technologien beschäftigen. Mit ein paar Prompts kann man leicht Gedanken generieren. Ein Werkzeug, um Ideen zu visualisieren. Aber was ist, wenn wir rassistische Inhalte generieren wollen? Es begann, als ich ein Gespräch mit einem Kommilitonen führte. Es ging um die rassistischen Stereotype in Malaysia. Mein Kommilitone fragte mich, welche rassistischen Stereotype es in Deutschland gibt. Ich sagte, dass das häufigste rassistische Stereotyp junge Männer mit ausländischer Nationalität seien, die teure Autos fahren. Ich wollte ihm ein visuelles Beispiel zeigen und kam auf die Idee, Dalle2 zu verwenden, um ein Bild zu generieren.

Da ich ein Deutschen Kontext bei der Beschreibung benutzt habe, waren für mich die Ergebnisse verblüffend. Ich habe nicht erwartet, dass solche akkuraten Bilder generiert werden. Die Bilder könnten gut auch aus der klatsch Presse stammen, die oft solche Titelbilder benutzen. Mich interessierte aber eher, welche Schlagwörter solche Bilder erzeugen. Den in meinen, jetzigen Wort Konstellationen, sind Wörter innhalten, die rassistische und aggressive Abbildungen provozieren. Ich stellte mir die Frage, welche Bilder generiert werden, wenn ich neutrale Wörter benutze. Denn nach meinem Empfinden sind die meisten Beschreibungen von Migranten in Deutschland, Negativ konnotiert.

Zu der Zeit stoß ich auf diesen Artikel:

https://medium.com/the-generator/is-dall-e-antisemitic-9540e8427a41

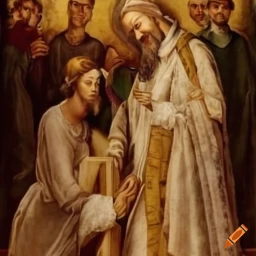

Im Artikel geht’s um einen Juden der sich gefragt hat, ob DALLE2 rassistische Bilder erzeugt, wenn man als Prompt Jude eintippt. Der jüdische Glaube wird im Internet, meistens in einer stereotypischen bis rassistische Form abgebildet. Die Ais greifen auf riesige Bibliotheken aus dem Internet. Daher können die Ergebnisse, nicht nach Ethischen Grundsätzen gefiltert werden. Auch stellt sich hier die Frage, woran eine Technologie, rassistische Inhalte erkennen kann? Während die Filterung bei Gewalt Inhalten einfach ist, sehe die Security Bots von YouTube. Sieht das bei diffamierenden Inhalten anders aus. Soll ein Rassistischer Inhalt anhand des Bartes oder Hautfarbe erkannt werden? Doch weiter im Text. Der Autor bekommt bei seinem Test, wie vermutet, explizite Karikaturen und meist rassistische Bilder generiert. Als Vergleich gibt er die gleichen Konstellationen ein nur mit dem Unterschied, dass nun dort Muslim oder Christ steht. Bei diesen Ergebnissen bekam er weit harmlosere Ergebnisse nach seiner Meinung. Dieser Artikel machte mich Neugierig. Denn in AI werden meist Daten aus Englischsprachigen Ländern generiert. Was wird wohl generiert bei Deutschen Kontext? Was kommt heraus, wenn wir in das Eingabefeld, Türke oder Deutscher schreiben? Oder Deutsch-Türke? Wird mir dann ein Mensch generiert mit einem dunkleren Teint? Oder ein knallblonder Deutscher? Oder wird was ganz anderes generiert? Ich schrieb diese Promps in Dalle 2 ein und dass waren die Ergebnisse.

German Person

Die Ergebnisse habe ich zweimal Generieren lassen. Die Ergebnisse waren von normal bis leicht stereotypisch zu ordnen. Die Bilder waren nicht wirklich dramatisch einzuordnen. Sie wirken nicht unbedingt rassistisch. Daher generierte ich den Prompt Deutsch-Türke.

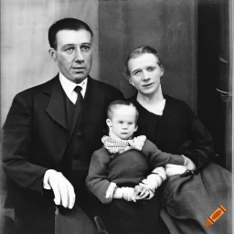

German-Turk

Die Ergebnisse erinnerten mich teilweise an Spiegel Magazine und Bild Zeitung Artikel der frühen 2010er. Wenn in Deutschland eine Straftat von Menschen mit Migrationshintergrund begangen wurde. Wird dies Wochenlang in Deutschen Printmedien behandelt. Die Generierten Bilder waren ähnlich wie die Abbildungen dieser Artikel. Teilweise, waren die Bilder eher Neutral zu bewerten. Ein weiter Punkt, waren die historischen Bilder. Im ersten Weltkrieg gab es eine Allianz zwischen dem Osmanischen und dem Deutschen Kaiserreich. Viele der Bilder erinnern an diese Zeit. Ich weiß, zwar nicht warum solche Bilder generiert werden, Doch durch diese Recherchen beschloss ich dann dieses Thema näher zu untersuchen.

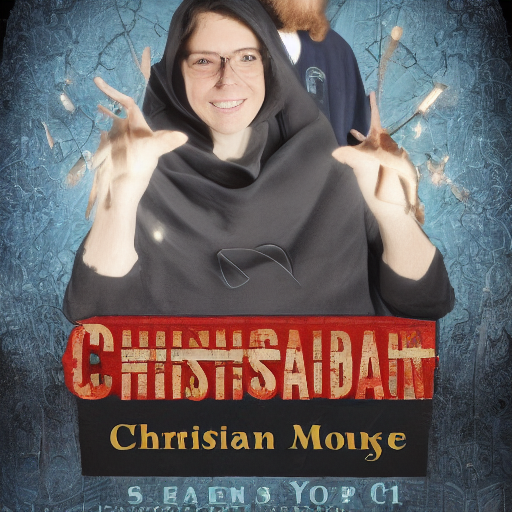

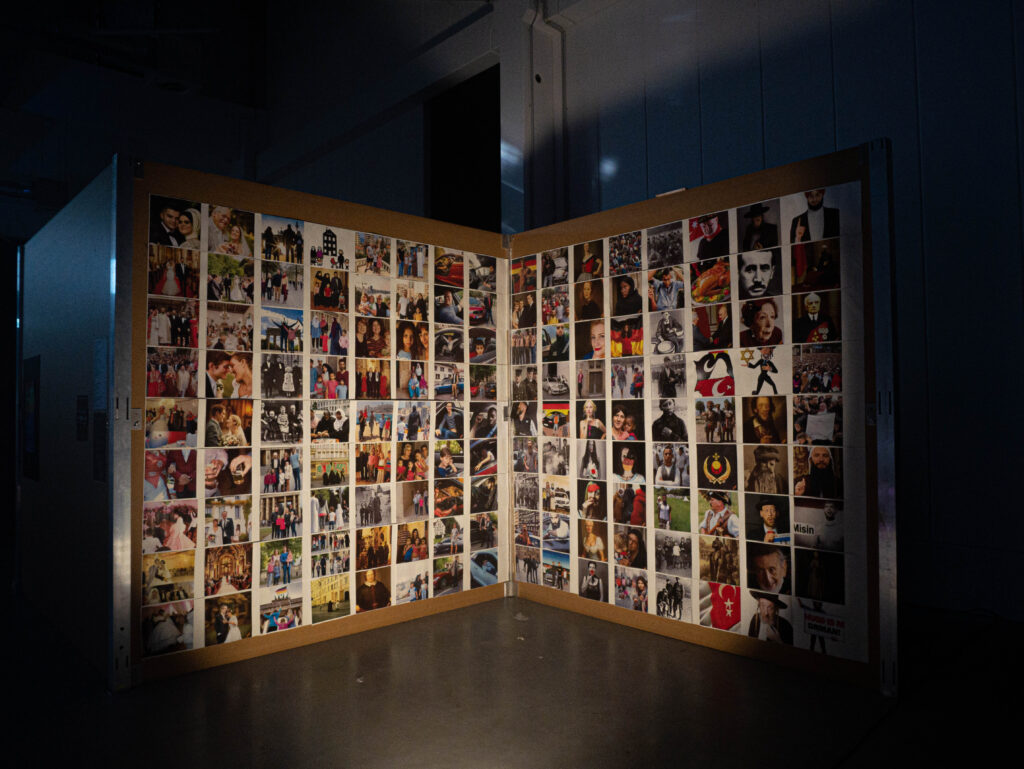

Austellung

Für die Ausstellung war es mir wichtig zu entscheiden, welche Bilder präsentiert werden. Es ist entscheidend, harte Kontraste in den Vordergrund zu stellen, da es darum geht, einen Umstand den Betrachtern zu vermitteln, der oft nur als Gefühl oder Übertreibung abgewertet wird. Daher sind die Direktheit und die Nachwirkung der Bilder für mich in der Ausstellung sehr wichtig. Die menschliche Psyche neigt dazu, Missstände, die uns nicht betreffen, als unproblematisch zu bewerten, während dieselben Umstände für die betroffenen Personen oft sehr belastend sind.

Deshalb ist es so wichtig, in diesem Projekt Nationalitäten und Kulturen zu vergleichen, um beiden Seiten klarzumachen, dass sie als Stereotype dargestellt werden. Denn nicht nur Minderheiten, auch die Mehrheitsgesellschaft, in diesem Fall die Deutschen, werden oft nur als blond und blauäugige Karikaturen dargestellt. Erst durch den Vergleich kann ich aufzeigen, wie stark die Stereotype in Prompts über Migranten sind. Denn viele könnten auch argumentieren, dass die Bilder „normal“ seien. Deshalb ist der Vergleich so wichtig. Wie Sie gleich sehen werden, zeigt die KI bei dem Begriff „deutsche Familie“ eine völlig perfekte Welt, während bei der „arabischen Familie“ extrem rassistische Bilder generiert werden.

Durch die Besucher, kamen ganz unterschiedliche Blickwinkel ans Licht, die man als Entwickler nicht erkennt. Denn als Künstler befindet man sich im Schaffensprozess oft in einer Art Tunnelblick und definiert das Werk vollständig für sich selbst. Der wichtigste Aspekt meiner Arbeit ist der Dialog. Denn innerhalb meiner Ausstellung beobachte ich die Besucher. Sie diskutieren und interpretieren völlig unterschiedliche Ansätze meiner Arbeit. Manche sahen Geschichten darin, andere Gäste betrachteten die Bilder in einer anderen Reihenfolge. In diesem Prozess greife ich ein und erkläre den Besuchern, was meine Arbeit tatsächlich darstellt. Dadurch entstanden viele interessante Dialoge, durch die ich auch viel über mich selbst gelernt habe. Denn viele dieser Gespräche helfen bei Kunstprojekten, eine Definition der eigenen Arbeit zu finden. In solchen Prozessen lernt man auch viel über sich selbst.

Am Ende des Tages sind die Bilder eigentlich ein Spiegel der Gesellschaft. KI generiert nur das, wonach wir Menschen suchen und was wir posten oder hochladen. Auch wenn wir dazu neigen, in solchen Projekten mit dem Finger auf andere zu zeigen, soll mein Projekt tatsächlich den Finger auf uns selbst richten. Denn wir alle kennen diese Bilder oder hatten sie in Zeiten des Populismus im Kopf. Daher habe ich die Beleuchtung absichtlich frontal gegenüber dem Projekt angebracht, sodass der Schatten der Gäste auf die Bilder fällt – eine Symbolik dafür, dass wir Teil dieser Bilder sind. Mein Projekt ist eine kritische Auseinandersetzung mit unserer Gesellschaft. Solche Probleme werden oft durch eine rosarote Brille romantisiert. Deshalb suche ich immer nach Wegen, Kunstprojekte zu schaffen, die Missstände aufzeigen, insbesondere in Deutschland. KI ist hier ein effektives Mittel, da sie sehr direkt zeigen kann, wie die Deutungshoheit in einem Land verankert ist. Vielleicht können wir in der Zukunft KIs nutzen, um zu erforschen, wie ein Land denkt oder fühlt.